这些年我越来越明显地感觉到一件事:很多人谈 AI 应用时,总是停留在“能不能用”的阶段,却很少认真考虑“怎么把它稳定地跑起来”。实际上,如果你打算长期使用一个 AI 工具,把它部署到自己的服务器上几乎是绕不开的一步。OpenClaw 就是这样一个典型的系统——灵活、强大,但也需要一定的部署经验。

说实话,我第一次部署 OpenClaw 时也踩过不少坑,从服务器环境准备,到 API 接入,再到运行监控和安全策略,很多细节如果不提前想清楚,后面运维会非常痛苦。下面这篇文章,我会结合自己的实际经验,慢慢聊聊 OpenClaw 在服务器上的完整部署流程,以及一些我认为非常关键、却经常被忽略的运维细节。

OpenClaw 简介

OpenClaw 的核心功能

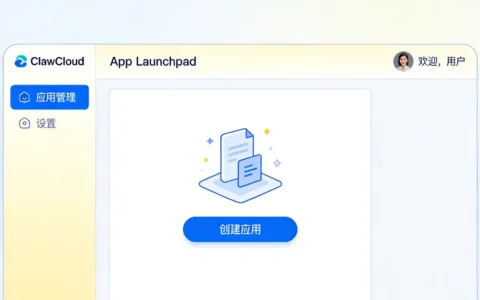

我第一次接触 OpenClaw 的时候,其实挺意外的。很多人会把它简单理解成一个 AI 工具框架,但在我看来,它更像是一个“AI 服务的整合平台”。

它能够把大模型能力、消息平台、自动化任务整合到同一套系统里运行。换句话说,你不只是调用一个模型,而是在搭建一整套 AI 服务体系。这个差别看起来不大,但用久了会发现意义完全不同。

有意思的是,OpenClaw 在架构设计上其实非常务实。它并没有试图把所有事情都做复杂,而是提供了足够灵活的组件,让开发者自己组合。

我个人非常喜欢这种设计方式——简单,但不简陋。

应用场景与优势

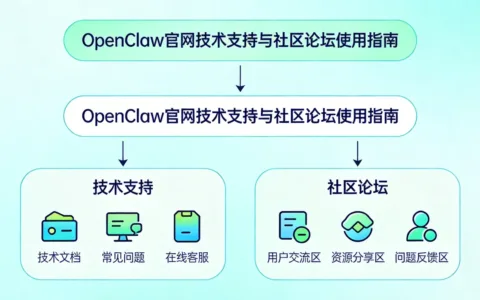

很多朋友会问我:“OpenClaw 适合什么场景?”

这个问题其实没有唯一答案。根据我的观察,它最常见的应用主要集中在几个方向:自动客服系统、团队助手、消息机器人,以及一些企业内部的 AI 自动化工具。

尤其是当你把 OpenClaw 接入聊天平台之后,整个系统会变得非常有意思。它不再是一个单纯的 API 服务,而是变成一个可以和用户互动的智能系统。

换句话说,你其实是在搭建一个 AI 助理。

当然,这也意味着部署和运维的重要性会被无限放大。因为一旦系统上线,就很难随便停机了。

服务器环境准备

操作系统与硬件要求

说到部署环境,我通常会建议大家不要过度复杂化。很多人一上来就想用各种云架构,其实没必要。

在大多数情况下,一台 Linux 服务器就已经足够。

我自己最常用的是 Ubuntu 或 Debian 系统。原因很简单:稳定、生态好、社区资料多。如果出了问题,你基本都能在论坛或者文档里找到答案。

至于硬件配置,我一般会建议至少 2 核 CPU、2GB 内存。听起来不算高,但对于很多轻量部署来说其实刚刚好。

当然,如果你打算同时服务很多用户,那就另当别论了。

依赖软件安装

服务器准备好之后,接下来就是依赖环境。

这一部分看起来很简单,但实际上往往是新手最容易出问题的地方。

根据我的经验,以下几个组件基本是必不可少的:

- Git(用于代码管理)

- Docker 或运行环境

- Python 或 Node 相关运行库

- 系统网络工具

说到这里顺便提一句,其实很多人忽略了一个问题——版本兼容。

我曾经见过有人因为系统 Python 版本不一致,导致部署过程反复报错。后来才发现,问题根本不在代码,而是在环境。

所以我现在的习惯是:环境版本尽量固定。

网络与安全配置

这一部分往往是最容易被忽略的。

很多人部署完程序就直接开放端口,然后就上线运行。说实话,这种做法风险非常大。

我通常会先确认几件事情:

- 服务器 SSH 是否只允许密钥登录

- 防火墙规则是否只开放必要端口

- HTTPS 是否已经配置

为什么我对这些这么敏感?

因为 AI 系统往往涉及 API Key,一旦泄露,损失可能非常直接——尤其是大模型调用费用。

所以我一直觉得,部署 AI 系统其实更像是在做一个互联网服务,而不是简单跑个程序。

OpenClaw 安装与部署

源码安装步骤

如果你喜欢掌控感比较强的部署方式,我其实会建议源码安装。

这种方式最大的优点就是灵活。

你可以直接修改配置、调整逻辑,甚至在必要的时候进行二次开发。

通常来说流程并不复杂:下载项目代码、安装依赖、配置环境变量,然后启动服务。

听起来很简单,但我得坦白一句——真正耗时间的往往不是安装,而是调试。

尤其是在接入模型 API 的时候。

Docker 部署方案

如果你问我更推荐哪种部署方式,我可能会说 Docker。

原因很现实:稳定。

Docker 的好处在于,它把运行环境打包在一起。换句话说,程序在开发环境能跑,部署到服务器基本也能跑。

这一点在团队协作中尤其重要。

很多时候运维问题不是代码问题,而是环境差异问题。Docker 可以很好地解决这个麻烦。

当然,它也不是万能的。有些人不太习惯容器化管理,这就见仁见智了。

配置文件与参数优化

OpenClaw 的配置文件其实非常关键。

很多系统运行是否稳定,很大程度上取决于这里。

我一般会重点检查以下几个配置:

- 模型 API Key

- 接口调用限制

- 日志级别

- 并发参数

有时候一个小小的并发配置,就可能让服务器压力翻倍。

所以我通常会在部署初期把参数调得保守一点,然后再慢慢优化。

运行与监控管理

服务启动与停止

系统部署完成之后,接下来就是服务管理。

我个人非常推荐使用 Systemd 来管理服务。

原因很简单:它稳定,而且和 Linux 系统结合得非常好。

如果服务意外崩溃,Systemd 可以自动重启。这一点在生产环境里真的非常重要。

有些团队也会使用 Docker Compose 来管理服务,这也是不错的选择。

日志管理与分析

日志这个东西,说实话平时没人看,但一旦出问题,所有人都在找它。

我自己有个习惯:一定要把日志单独存储。

原因其实很简单——当系统崩溃时,日志往往是唯一的线索。

另外,我还会定期检查日志大小。

你可能想不到,一些系统运行几个月之后,日志文件能大到几十 GB。

性能监控与优化

性能监控其实是一件挺有意思的事情。

刚开始的时候,服务器资源看起来总是很充足。但随着用户增加,问题会慢慢出现。

CPU 使用率、内存占用、网络带宽——这些指标都会影响系统稳定性。

我一般会部署简单的监控工具,比如 Prometheus 或 Grafana。

这样一旦资源异常,就可以第一时间发现。

运维与安全建议

用户权限与安全策略

说到安全,我一直觉得很多技术文章写得太轻描淡写。

但实际上,一旦系统上线,安全就是头等大事。

我通常会做几件事情:

- 限制服务器登录用户

- 隔离服务运行权限

- 定期更新系统补丁

这些措施看起来很普通,但往往能避免很多潜在风险。

自动化备份与恢复

备份这件事情,说实话只有出过事故的人才会真正重视。

我以前就遇到过一次服务器磁盘损坏,所有数据差点丢失。那次之后,我就再也不敢忽视备份了。

通常我会设置定期自动备份,包括配置文件、数据库和日志。

这样即使服务器出现问题,也可以快速恢复。

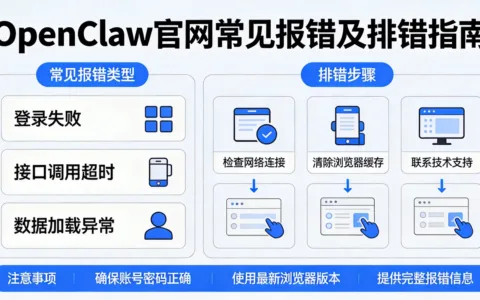

常见问题排查指南

部署 OpenClaw 的过程中,最常见的问题其实并不复杂。

比如 API Key 配置错误、端口未开放、服务未启动。

但问题在于,当这些问题叠加在一起时,就会变得很难定位。

我通常的排查顺序是:网络 → 服务状态 → 日志 → 配置文件。

这个顺序其实挺有效的。

实战案例分享

小型部署实例

我曾经帮一个小团队部署过一套 OpenClaw 系统。

他们的需求其实很简单:一个团队助手,用来处理日常消息和 AI 查询。

整个系统只用了一个 2 核 4GB 的云服务器。

令人惊讶的是,这套系统运行了一年多,几乎没有出现过严重问题。

这让我意识到,其实很多 AI 应用并不需要特别复杂的基础设施。

大规模集群部署经验

当然,如果用户规模很大,事情就完全不同了。

在一些企业环境里,我见过 OpenClaw 运行在多台服务器组成的集群上。

负载均衡、容器编排、监控系统都会加入进来。

这个时候,部署就不只是技术问题了,还涉及架构设计。

有时候我会觉得,运维其实更像是一门艺术。

总结与最佳实践

部署关键点回顾

如果让我总结 OpenClaw 部署最关键的几点,我会强调三个方面:

- 稳定的服务器环境

- 合理的配置参数

- 完善的监控体系

很多系统出问题,其实都不是技术本身的问题,而是细节没有处理好。

部署 AI 系统也是一样。

运维优化建议

最后我想说一点个人感受。

很多人觉得部署系统是一件一次性的事情,但其实完全不是。

真正困难的,是长期运行。

服务器会更新、系统会升级、模型 API 也可能变化。换句话说,运维其实是一个持续过程。

所以我个人一直建议:不要把部署当作终点,而要把它当作一个长期维护的开始。

OpenClaw 的部署其实并不复杂,但真正决定系统质量的,是部署后的运维能力。从服务器环境、安全策略,到监控与备份,每一个环节都会影响系统稳定性。只要把这些基础工作做好,即使是一台普通服务器,也能稳定运行一个强大的 AI 服务系统。

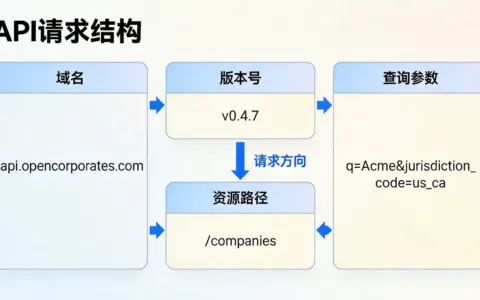

如何部署 OpenClaw 到服务器?

部署 OpenClaw 到服务器需要准备合适的环境,安装所需依赖,并配置 API 接口。确保服务器配置符合系统需求,避免后期因资源不足导致的运行问题。

OpenClaw 支持哪些应用场景?

OpenClaw 适用于自动客服、团队助手、消息机器人等多个场景,尤其是能通过接入聊天平台,成为互动智能系统,提升用户体验。

如何确保 OpenClaw 部署后的系统安全?

部署后需要对系统进行安全加固,包括 API 接口权限控制、数据加密和防火墙配置。定期进行系统更新和监控,以防止潜在的安全漏洞。

OpenClaw 的运维有哪些关键细节?

运维中需关注系统资源使用、API 调用稳定性及异常监控。及时优化性能,处理可能的网络故障,确保系统持续稳定运行。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://www.siyushenqi.com/72887.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫