Anthropic的创建理念是建立符合人类价值观的AI系统,以及促进AI的公平、透明和可信。该公司认为,现有的大语言模型可能会产生一些危险、有偏见或不良的输出,AI安全研究需要降低甚至排除它们做坏事的可能性。

-

如何让AI系统理解和尊重人类的意图、偏好和价值观?

-

如何让AI系统能够解释其行为和决策的原因和后果?

-

如何让AI系统能够接受人类的指导和反馈,并根据需要进行调整和修正?

-

如何让AI系统能够遵守法律、道德和社会规范,以及承担相应的责任?

-

如何让AI系统能够与人类以及其他AI系统进行协作和协调,以实现共同的目标?

对于本次谷歌投资一事,Anthropic的联合创始人和首席执行官Dario Amodei表示,“我们很高兴与谷歌云合作,因为它们提供了我们需要的开放式基础设施,以及对AI安全和可靠性的承诺 ”。谷歌云的首席执行官 Thomas Kurian也表示,“谷歌云正在为下一代人工智能初创公司提供开放式基础设施,我们与Anthropic的合作是一个很好的例子。我们期待看到他们如何利用我们的技术来推动AI的发展”。

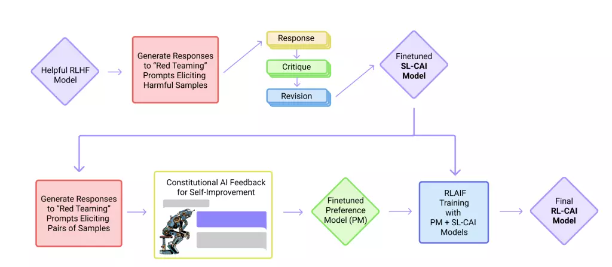

作为一种有帮助而又无害的助手,它旨在解决对AI系统的透明度、安全性和决策制定的担忧,而不依赖于人类的反馈来评估响应。

也许,赋予人工智能可遵循规则的想法可能听起来很像科幻小说家艾萨克.阿莫西夫提出的所谓的机器人三定律:

根据Anthropic的说法,Claude证明了合宪AI的有效性,它可以“更恰当地”回应对抗性输入,同时仍然提供有用的答案,而不诉诸逃避。

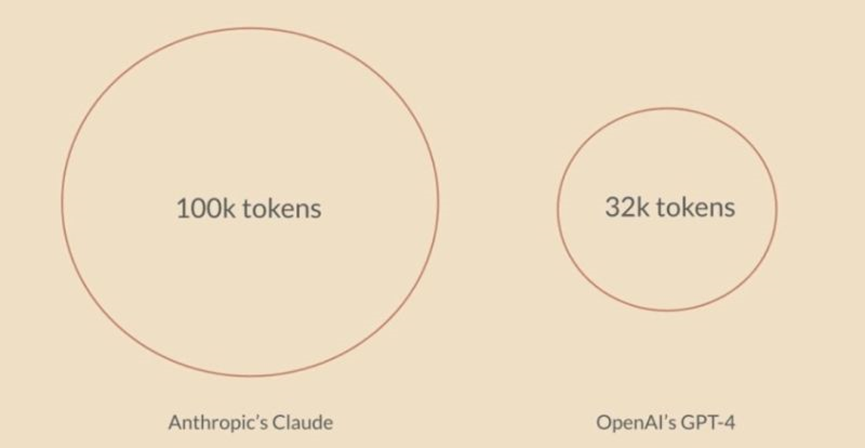

◉ 上下文token

GPT-4在GPT-3.5的4,000上限基础上多了8倍,可达32,768个token,大约25,000个单词。Claude能够支持100,000的上下文token长度,大约75,000个单词。显然,Claude从数量层面的内卷获得了本轮胜利。

◉ 准确性

Claude总体上没有GPT-4擅长计算和编程,故GPT-4在许多领域都比Claude更精确,但Claude在某些创意性用例中效果更好,单论准确性,GPT-4胜。

◉ 集成

在集成这一方面,二者平分秋色,不过单从伙伴表态来看,Claude大约略胜一筹。

◉ 安全

前文已经提及Anthropic是以Constitutional AI为基础来构建Claude,使其更具有无害输出的同时,能够对用户的对抗性输入进行有效回应。Claude或许算是在安全方面做出了更多号召与努力。

◉ 价格

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://www.siyushenqi.com/35294.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫