OpenClaw简介

OpenClaw的核心功能

OpenClaw是一个自托管的AI代理框架,结合了浏览器自动化与HTTP抓取功能,能够高效地进行网页数据采集。简单来说,它能通过模拟浏览器行为处理动态网页中的JavaScript内容,或者通过直接的HTTP请求抓取静态数据。这种灵活的配置方式使得它在面对不同类型的网页时,能够找到最佳的抓取方法。

其中,浏览器自动化抓取是OpenClaw的一大亮点。它允许你通过控制真实的浏览器环境,模拟用户行为,抓取任何包含JavaScript渲染内容的动态页面。这对于需要实时互动或复杂渲染的网页尤其有效。

适用场景与优势

OpenClaw的适用场景非常广泛。从电子商务网站的数据提取,到新闻网站的实时更新,甚至社交媒体内容的收集,都能发挥其强大的抓取能力。特别是在面对反爬虫机制较强的站点时,OpenClaw通过代理池、反反爬策略和动态内容处理,能够有效绕过多数限制。

其最大的优势在于灵活性和可定制性。通过Firecrawl等抓取技能,用户可以轻松配置代理和任务调度,让抓取任务更加精准和高效。

系统与环境要求

使用OpenClaw的前提是具备一定的技术基础,特别是对Python、浏览器自动化及HTTP请求有一定了解。此外,系统需要支持Python环境,安装所需的依赖库,以及配置适当的数据库用于存储抓取的数据。值得注意的是,OpenClaw对硬件要求并不高,但当涉及到大规模抓取时,可能需要一定的计算资源来优化性能。

动态网页抓取基础

静态网页与动态网页的区别

静态网页和动态网页的最大区别在于内容的加载方式。静态网页的内容在页面加载时就已经完全呈现,而动态网页则依赖于JavaScript脚本在加载后动态生成内容。这意味着,抓取动态网页时,普通的HTTP抓取方法无法直接获取到页面的完整数据,必须使用浏览器模拟或执行JavaScript才能获取。

抓取动态内容的挑战

抓取动态内容是当前网页抓取中的一大挑战。首先,动态页面的内容是通过JavaScript异步加载的,传统的抓取方法无法直接获取到这些内容。其次,现代网站往往使用复杂的反爬虫策略,例如验证代码、IP封锁、动态内容加载等,这让抓取变得更加复杂。针对这些问题,OpenClaw通过结合浏览器自动化和HTTP抓取两种方式,有效解决了这些抓取难题。

常用抓取方法概览

常见的网页抓取方法主要有三种:HTML解析抓取、浏览器自动化抓取和API抓取。HTML解析抓取适用于静态网页,通过直接解析网页的HTML结构获取数据。浏览器自动化抓取则适用于动态网页,通过模拟浏览器行为,获取JavaScript渲染后的内容。而API抓取则是直接调用网页提供的API接口,获取结构化的数据信息。

OpenClaw抓取配置详解

项目创建与基本设置

在开始使用OpenClaw之前,首先需要创建一个项目并进行基本设置。通过设置目标网页、选择抓取规则以及配置代理池等,可以为后续的抓取任务奠定基础。此步骤并不复杂,OpenClaw的配置界面友好,用户只需根据提示逐步完成设置即可。

目标网页选择与规则定义

抓取任务的成功与否,往往取决于目标网页的选择以及抓取规则的定义。用户需要根据网页的结构,灵活配置规则,确保数据抓取的精准度。OpenClaw支持用户定义CSS选择器、XPath规则等,通过这些规则,系统能够准确地定位页面中需要抓取的内容。

动态内容处理技巧

抓取动态网页时,OpenClaw能够通过模拟浏览器加载过程,抓取到页面上的JavaScript渲染内容。值得一提的是,在面对需要用户交互的网页时,OpenClaw也支持自动化模拟用户点击、滚动等操作,确保所有需要的数据都能被成功抓取。

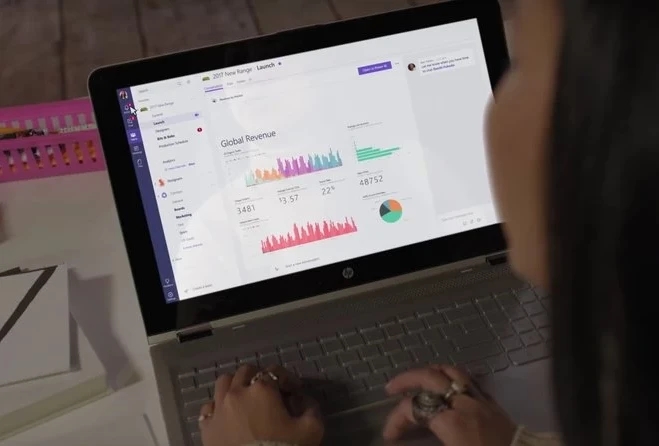

数据存储与输出配置

抓取到的数据最终需要存储和输出。OpenClaw支持多种数据存储格式,包括JSON、CSV、SQL等,用户可以根据需求选择适合的格式。此外,OpenClaw还支持将抓取数据直接输出到数据库,方便后续的数据分析和处理。

高级抓取技巧与优化

模拟用户行为与防反爬策略

随着网站反爬虫机制的日益加强,简单的抓取方法已无法满足需求。OpenClaw通过模拟真实用户的浏览行为,能够有效绕过验证码、IP封锁等常见的反爬虫策略。此外,配置合理的请求头、延时设置和代理池,也能进一步提高抓取的成功率。

异步请求与延时处理

为了提高抓取效率,OpenClaw支持异步请求。通过异步请求,用户可以在等待某个网页加载的同时,抓取其他网页的内容,从而减少抓取的总时间。此外,延时处理能够有效避免过于频繁的请求造成IP被封的风险。

多线程与分布式抓取

对于大规模抓取任务,OpenClaw支持多线程和分布式抓取。通过将任务分配到多个线程或服务器上,抓取过程可以更加高效。值得注意的是,分布式抓取需要额外的资源和配置,因此在使用时需要合理评估抓取任务的规模。

抓取效率与资源优化

优化抓取效率是提高工作流性能的关键。通过合理配置代理池、定时任务、请求队列等,OpenClaw能够在保证抓取精度的前提下,最大限度地提高资源利用率。这不仅能提升抓取速度,还能避免因为资源消耗过大而导致任务失败。

案例实操

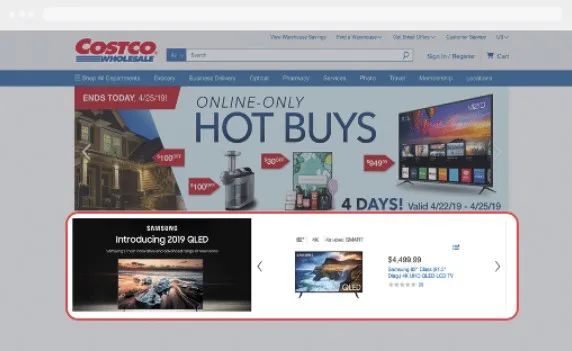

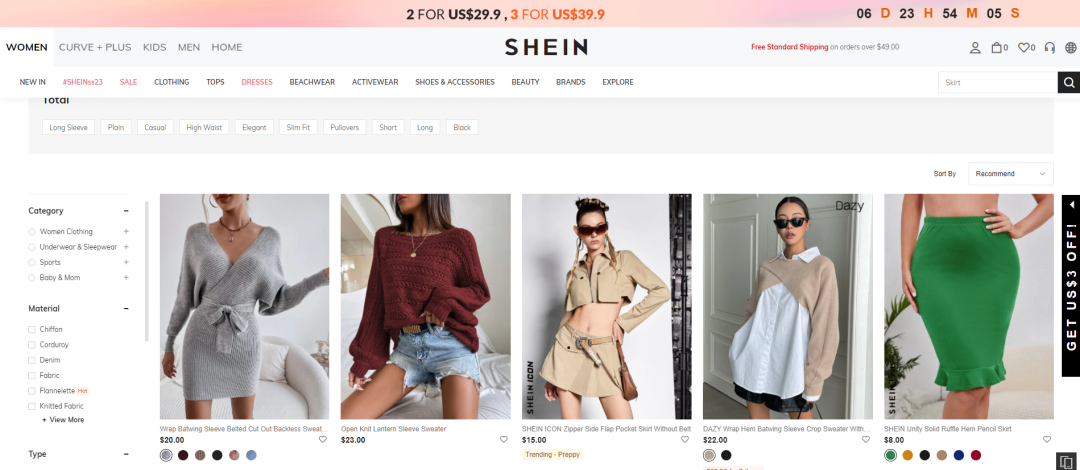

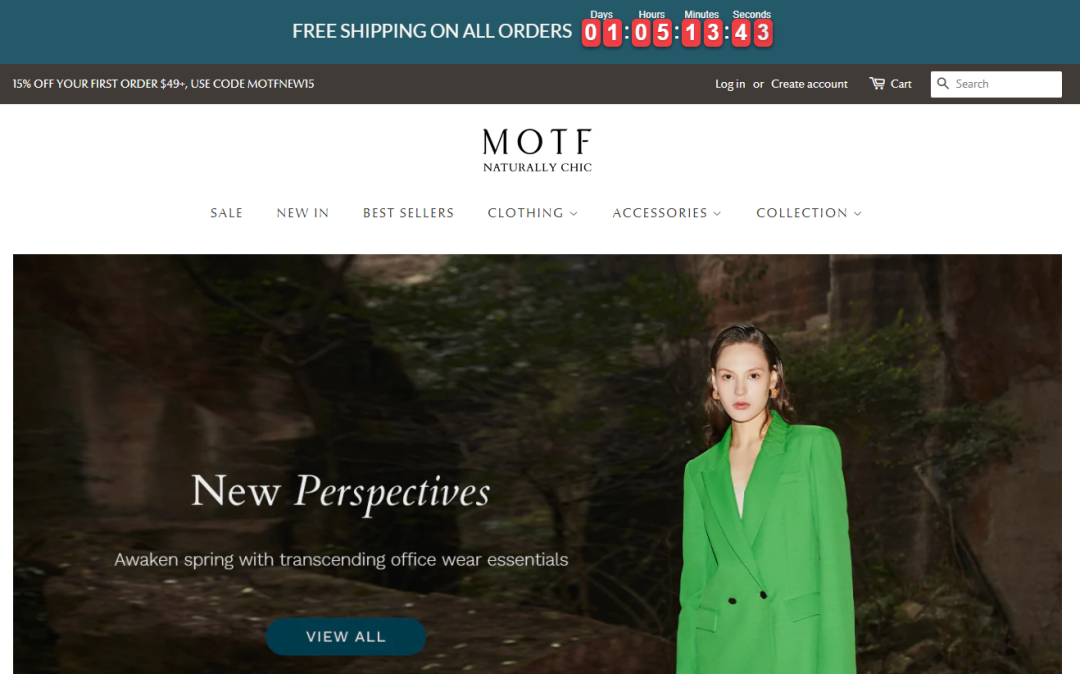

电商网站动态数据抓取

在电商网站抓取中,动态内容的更新频繁且复杂,OpenClaw能够轻松应对这一挑战。通过模拟用户登录、筛选条件和页面滚动等操作,抓取到最新的商品信息和价格数据。使用OpenClaw,用户能够实时获取电商网站的关键数据,帮助进行市场分析和竞争研究。

新闻门户内容采集

新闻网站的内容更新快速,且大量依赖动态加载。OpenClaw在这一场景下同样展现出了强大的能力。通过动态加载的方式,抓取最新的新闻标题、正文以及评论等信息。此外,OpenClaw还能通过定时任务配置,实现实时数据采集和存储。

社交媒体信息抓取

社交媒体平台的数据抓取是一个挑战,因为这些平台通常对爬虫有严格的防范措施。OpenClaw通过结合模拟用户行为和防反爬机制,能够绕过这些限制,抓取到微博、Facebook等平台的最新动态、用户评论等信息。

常见问题与解决方案

抓取失败的排查方法

抓取失败可能由多种原因引起,最常见的是网页结构发生变化或反爬虫策略加强。此时,用户可以通过检查日志文件、查看请求响应头以及调整抓取规则,逐步排查问题并解决。保持抓取任务的灵活性和可调节性是解决问题的关键。

数据丢失或重复处理

数据丢失或重复是抓取过程中常见的问题。通过精确的抓取规则配置和数据去重机制,OpenClaw能够减少这些问题的发生。此外,对于批量抓取任务,合理的任务调度和数据存储策略也有助于避免数据丢失。

反爬机制应对策略

针对反爬虫机制,OpenClaw有多种应对策略。例如,通过代理池、请求头伪装、延时请求等手段,可以避免被封IP或被限制抓取。结合Firecrawl等抓取技能,用户还可以模拟不同地区的访问请求,进一步增强抓取成功率。

总结与进一步学习

OpenClaw使用心得

使用OpenClaw最大的感受就是它的灵活性。无论是面对静态网页还是动态网页,它都能根据需求选择最合适的抓取方式。对于复杂的网站抓取任务,OpenClaw提供的多种高级配置和防反爬策略,使得任务更加稳健和高效。

扩展功能与插件推荐

OpenClaw的扩展功能非常丰富,通过集成Firecrawl、Decodo等插件,用户可以实现更加精准的抓取需求。这些插件不仅提高了抓取效率,也增强了数据处理的能力。对于有更高需求的用户,OpenClaw还支持自定义插件的开发,进一步提升了系统的适应性。

学习资源与社区支持

如果你想深入学习OpenClaw,可以参考官网提供的多篇教程,特别是针对浏览器自动化与抓取配置的实战案例。此外,OpenClaw的开源社区也提供了大量的学习资源和技术支持,是一个非常活跃的技术交流平台。

常见问题

OpenClaw如何抓取动态网页?

OpenClaw通过模拟浏览器行为处理JavaScript渲染的内容,能够抓取需要实时互动或复杂渲染的网页。

OpenClaw是否能够绕过反爬虫机制?

是的,OpenClaw通过代理池和反反爬策略,有效绕过大多数反爬虫限制。

使用OpenClaw时需要哪些系统要求?

需要具备Python环境,并安装相关依赖库,配置数据库以存储抓取的数据。

如何提高OpenClaw的抓取效率?

通过合理配置代理池、任务调度和抓取技能(如Firecrawl),可以显著提升抓取任务的效率和精度。

OpenClaw的硬件要求高吗?

OpenClaw对硬件要求不高,但进行大规模抓取时可能需要更多的计算资源。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://www.siyushenqi.com/72437.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫