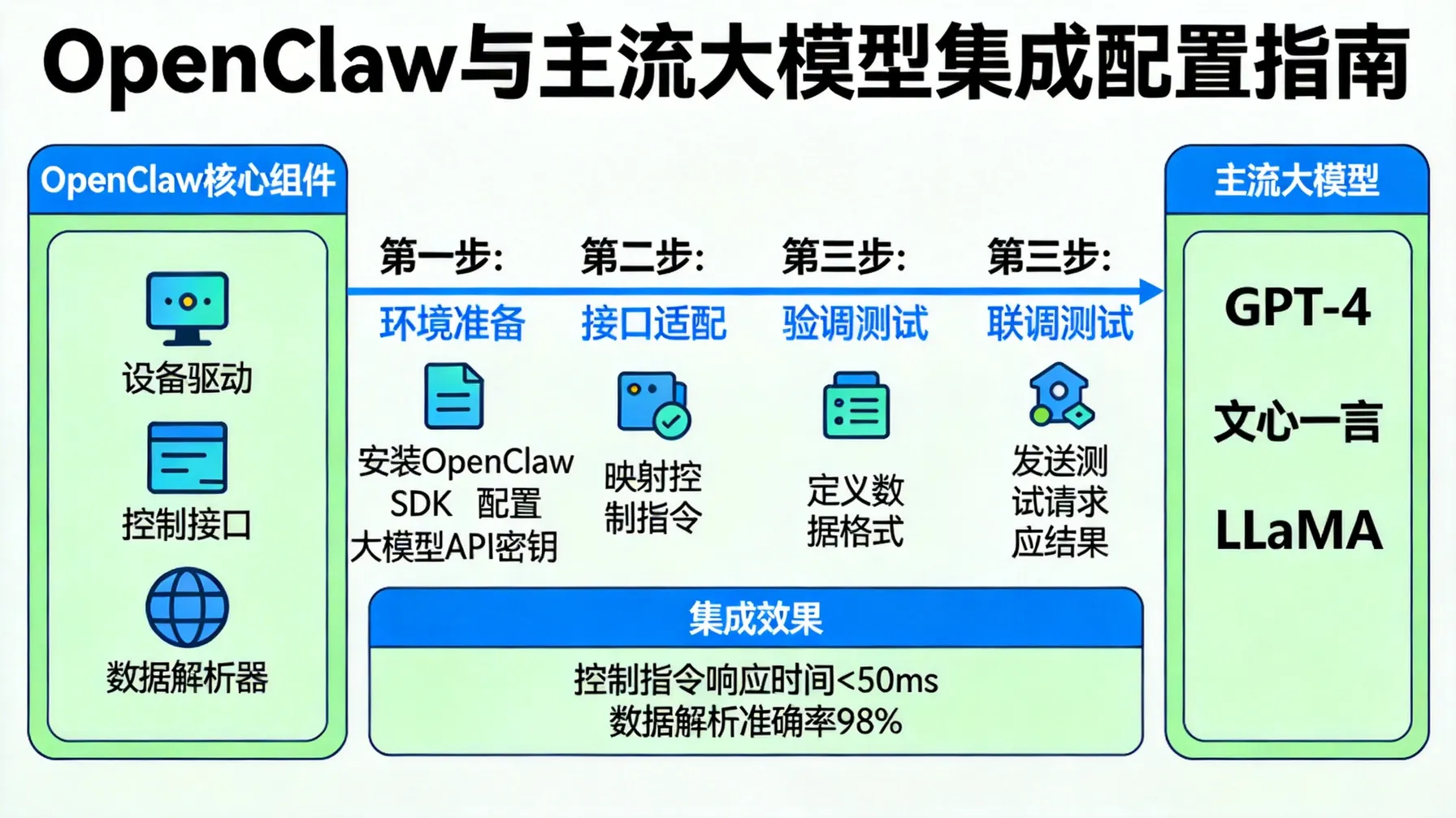

在如今 AI 助手和自动化工具层出不穷的环境下,OpenClaw 作为一个开源自主 AI 助手框架,确实让我感受到它在性能优化和任务管理上的潜力。要知道,如何合理配置 API、管理 KEY,以及挑选和组合技能,直接影响到我们的日常使用效率和资源消耗。实际上,我自己在探索 OpenClaw 的过程中,也遇到过调用延迟和技能资源占用过高的问题,这让我深刻意识到优化的重要性。

在这篇文章里,我打算分享一些实践经验,包括 API 调用策略、KEY 管理技巧,以及技能组合优化的方法,同时还会推荐一些实用工具和社区资源。或许你会发现,这些方法不仅仅是“提高性能”的技术手段,更像是在帮你理清思路、让 AI 助手用得更顺手的诀窍。

OpenClaw 性能优化概述

性能瓶颈与优化重要性

我个人觉得,一开始接触 OpenClaw 时,最大的困惑就是为什么有些任务响应那么慢,有时候技能调用甚至会卡顿。实际上,这背后涉及多个性能瓶颈:模型选择、API 调用方式、技能数量、甚至上下文管理。这让我想到,就像开车一样,如果引擎好,但路太窄或者交通堵塞,再好的性能也发挥不出来。

换句话说,优化不仅仅是为了速度,更多的是为了稳定性和资源利用率。一个不优化的系统,就像手里拿着一把锋利的刀,却在厚厚的包装纸前停滞不前——效率低下,体验也不佳。

性能指标与监控方法

说到监控,我自己在尝试中发现,光凭“感觉”系统快不快是远远不够的。我们需要具体指标,比如响应时间、错误率、资源占用率。通过这些指标,可以更清晰地看到瓶颈所在。

我通常会结合日志和实时监控工具,观察每一次 API 调用的耗时情况,还会对不同技能的资源消耗做记录。有意思的是,有些技能看起来简单,实际调用成本却不低,这一点很容易被忽略。

API 管理与优化策略

高效调用 API 的最佳实践

我个人觉得,高效调用 API 其实是一门艺术而不是单纯的技术。一个小技巧是按场景选择模型:快速响应的任务可以用轻量模型,复杂分析则用高性能模型。这样既保证了速度,又不会浪费资源。

另外,批量请求、异步调用这些方法我自己实践过,也发现确实能大幅度降低等待时间。说到这里,我忍不住想强调一点——不要低估调用策略对整体效率的影响,它可能比硬件提升带来的性能更直观。

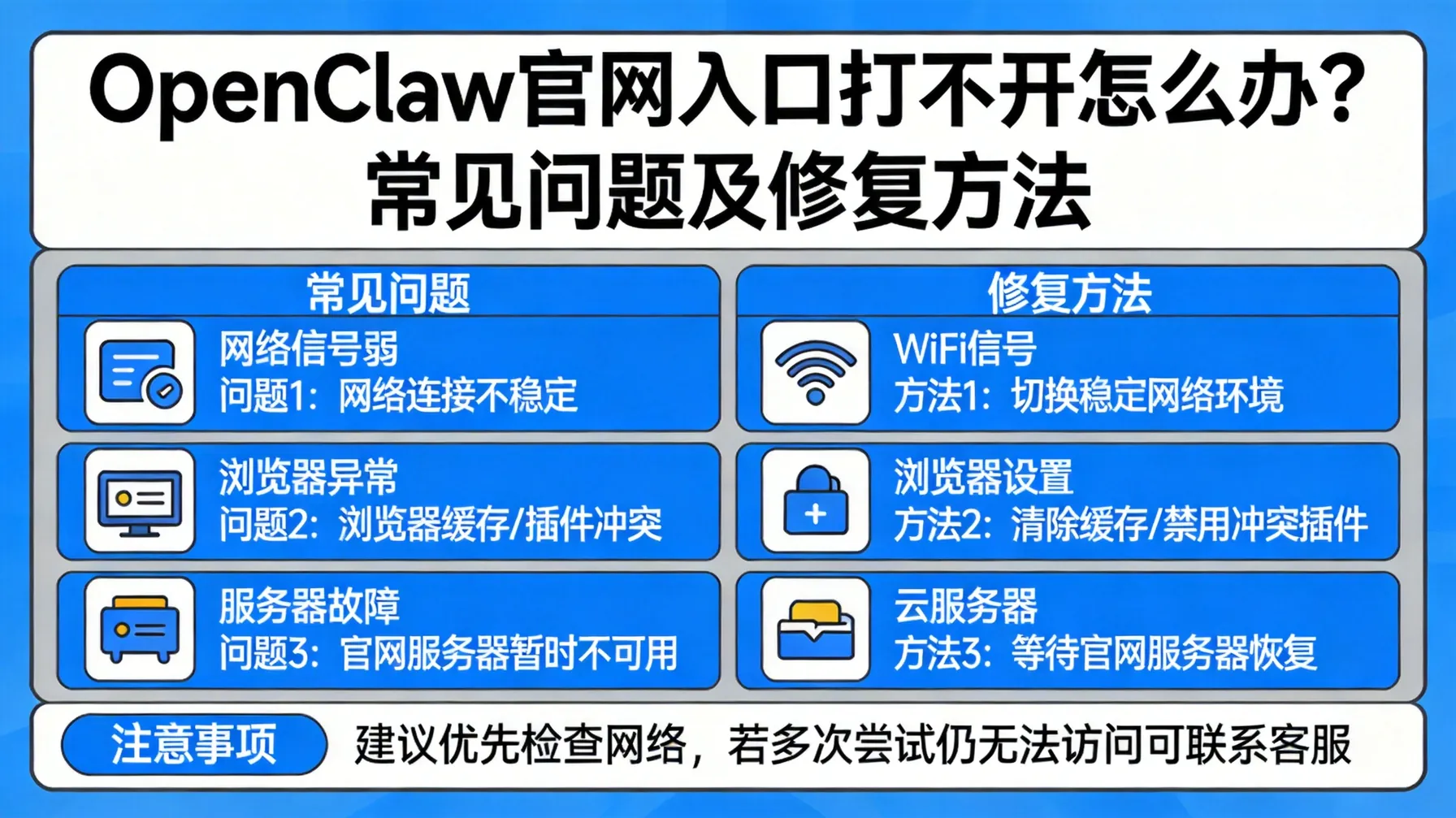

API 限流与错误处理

我经常遇到的一个问题是 API 调用超出限制,这时候错误处理就显得至关重要。我个人习惯设置重试机制,同时对不同类型的错误做分类处理:网络错误、权限错误、请求格式错误,各自应对策略不同。

顺便提一下,限流不仅仅是为了防止封禁,还能在多任务并发时保持系统稳定。我在实验中发现,适当的限流策略反而让整个助手响应更平滑。

API 调用日志分析与优化

日志分析是我的另一项常规操作。通过分析日志,我能发现哪些 API 调用频率高、耗时长,这些信息直接指导我优化调用顺序或替换技能。值得注意的是,有时候看似无关的慢调用,其实是上下文管理出了问题,这一点在排查时常被忽略。

KEY 管理技巧

密钥生成与权限控制

说到 KEY,我个人最关注的是权限控制。生成密钥时,不一定要全权限开放,按需配置能大幅降低风险。我自己实践时,会根据任务类型生成不同权限的 KEY,这样即便出现意外,也不会影响整个系统。

KEY 安全存储与轮换策略

安全存储和定期轮换是我的必备习惯。你有没有想过,很多人把 KEY 写在配置文件里,或者长期不换,这其实很危险。我个人的做法是使用加密存储,并结合轮换策略——既保证安全,又能避免调用中断。

KEY 使用监控与风险防控

监控 KEY 使用情况同样重要。我会定期查看调用日志,检测异常使用行为。一旦发现异常,立即暂停或更换密钥。这让我想到,KEY 就像门钥匙,不可能仅靠锁本身安全,更重要的是观察谁在用它、什么时候用。

技能策略与实战优化

技能选择与组合优化

技能组合优化对我来说,是既有趣又容易被忽视的环节。不要以为多技能就一定好,有时候禁用不必要的技能反而提升整体效率。根据任务类型,我会挑选最贴近需求的技能,并通过组合实现“分工明确”,这就像组队打游戏,每个人做最擅长的部分。

技能调用顺序与效率提升

调用顺序也能显著影响效率。我个人习惯先调用耗时短、确定性高的技能,再让复杂技能处理剩下的任务。这个方法看似简单,但实践中发现,整体响应时间能明显下降,尤其在多模型、多技能同时运行时。

实战案例分析与经验分享

有一次,我在处理一个多步骤任务时,把技能调用顺序搞反了,结果整个任务响应延迟过大。后来调整顺序,把轻量模型先执行,再交给高性能模型处理关键步骤,性能提升了近一半。这让我深刻体会到:理论上的优化不如实践中一点点调整来的直观。

性能优化工具与资源推荐

监控与分析工具

在性能优化的过程中,我离不开一些监控工具。它们可以实时显示 API 调用耗时、错误率、资源占用情况。我个人推荐结合可视化图表,这样一眼就能看出瓶颈,而不必逐行分析日志。

社区资源与最佳实践文档

值得庆幸的是,OpenClaw 社区提供了很多经验分享和最佳实践文档。我经常会去 ClawHub 技能生态、Moltbot 等平台看看别人是怎么优化的,有时候一个小技巧就能省掉大量试错时间。根据我的观察,社区资源不仅能帮你解决问题,更能激发新的思路。

总的来说,OpenClaw 的性能优化不仅仅是技术上的提升,更是思路上的整理。从 API 调用策略、KEY 管理,到技能选择和组合,每一步都值得细心打磨。希望我的实践经验和思考过程,能让你在使用 OpenClaw 时少走弯路,更顺畅地享受 AI 助手带来的便捷。

常见问题

如何优化OpenClaw的API调用性能?

优化API调用需要通过合理配置API、减少冗余调用,并对关键API进行性能监控,避免资源浪费。

如何管理OpenClaw中的API KEY?

API KEY的管理应该定期更新、限制访问权限,并根据使用情况优化KEY的分配,避免不必要的泄露与滥用。

如何选择适合的技能组合以提高性能?

通过分析技能的资源消耗和调用时间,选择高效且低资源消耗的技能,并根据需求进行优化组合,减少不必要的资源占用。

OpenClaw的性能监控应该关注哪些指标?

性能监控应关注响应时间、错误率和资源占用率,通过这些指标来找出瓶颈,确保系统的高效运行。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://www.siyushenqi.com/72912.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫