在如今各种自动化工具层出不穷的时代,OpenClaw免费版以其跨平台、易部署的特点吸引了不少开发者和爱好者。我个人在尝试安装和使用它的过程中发现,其实真正要让它发挥稳定和高效性能,并不只是“点几下安装就完事”,背后有不少小技巧值得注意。在这篇文章里,我会结合自身实践,带你从下载准备、安装步骤,到性能优化、界面体验提升,甚至安全配置和常见问题排查,全方位分享我的经验,希望能帮你少踩坑、多上手。其实,安装只是第一步,优化和安全管理才是让它长久好用的关键。

OpenClaw免费版安装指南

下载与安装前的准备

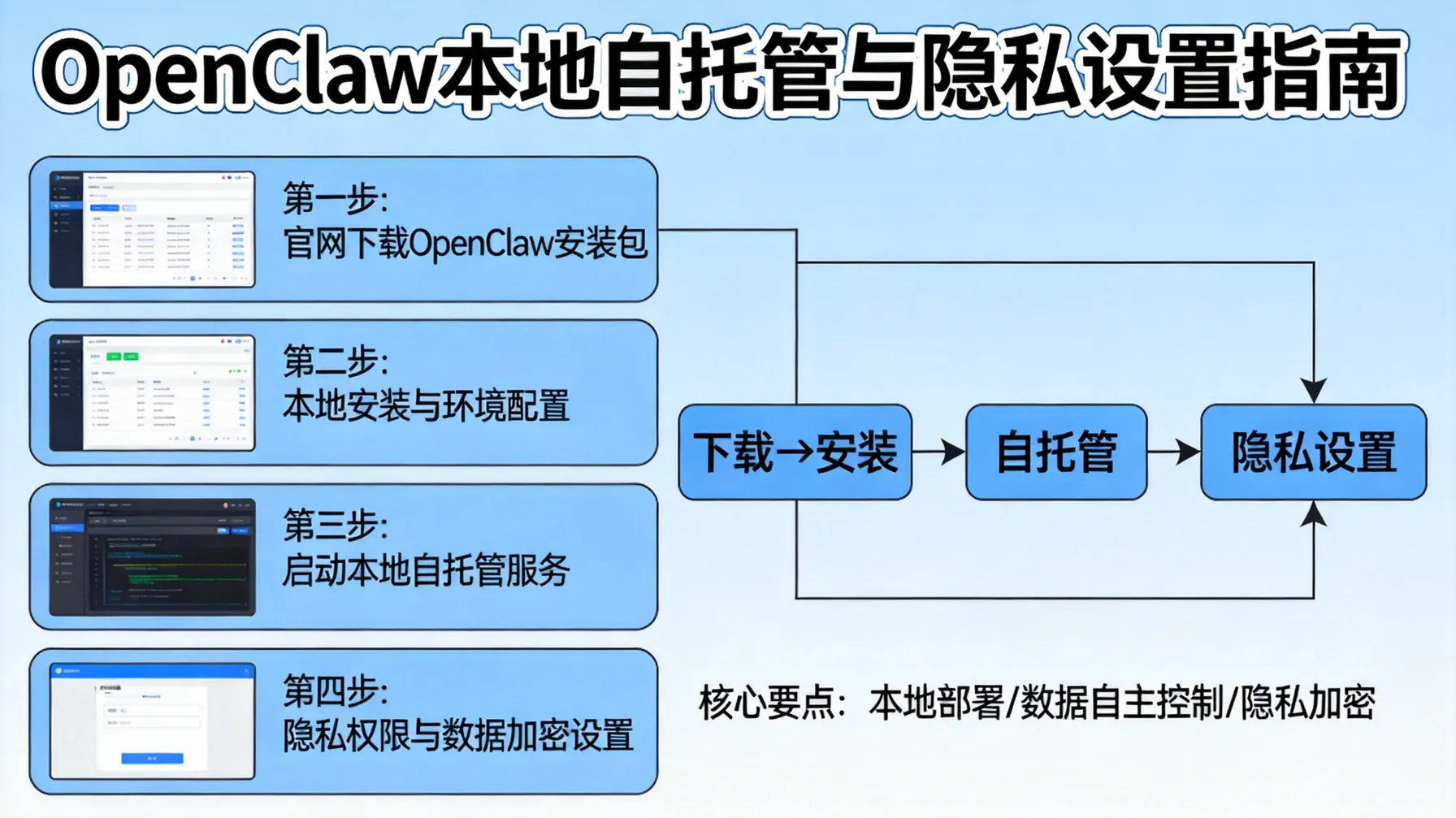

说到安装,第一件事往往是准备环境。老实说,我一开始总觉得安装就是把软件丢到电脑里就完了,但OpenClaw略有不同。它要求Node.js 22及以上,Windows用户还得通过WSL2环境来运行。这个设置看起来有些麻烦,但实际上,只要提前把这些环境准备好,后续就顺畅多了。

另外,我个人强烈建议先考虑系统权限和网络环境。虽然安装脚本官方已经做得比较完善,但如果权限不够或者网络不稳定,可能会遇到一些奇怪的问题。顺便提一句,确认消息平台账号和API配置也是提前的好习惯——安装完成后才能顺利接入各种服务。

安装步骤详解

安装脚本真的是救星,我自己的经验告诉我,这一步能省去大量麻烦。官方提供的一键部署脚本基本覆盖了大部分操作系统和常见场景。说实话,我最初还想手动配置环境,但后来发现一键脚本不仅省时,而且减少了潜在的错误。

在执行脚本前,我一般会先打开终端检查Node.js版本,确保满足要求,然后再运行安装命令。过程当中可以看到脚本自动下载依赖、配置环境变量,偶尔会提示需要确认一些选项,这个时候耐心点,按照提示操作就好。值得注意的是,如果是Windows用户,WSL2环境必须提前启用,否则脚本可能报错,这一点我自己踩过几次坑。

常见问题与解决方案

安装过程中总会遇到各种小状况,这很正常。我自己遇到过依赖冲突、脚本权限不足,甚至因为网络不稳定导致下载失败。通常的解决方法是先检查Node.js版本、系统权限和网络连接,再尝试重新运行脚本。

有时候错误信息可能看起来吓人,但仔细读一下,大多是环境配置的问题,而不是软件本身的缺陷。我个人的经验是,先排查最容易的因素,比如权限和依赖版本,再去考虑更复杂的方案。其实这个过程也让我理解了OpenClaw对系统环境的要求,并非无的放矢,而是为了保证后续运行稳定。

OpenClaw免费版优化技巧

性能优化

安装完成只是起点,真正要让OpenClaw跑得顺畅,还得做性能优化。我自己通常会调整一些配置文件,限制不必要的日志输出,并且根据实际使用场景调整内存和线程设置。有意思的是,有时候小小的改动就能显著提升响应速度,这让我意识到性能优化并非一定要复杂。

换句话说,性能优化更像是一个持续的观察和调整过程。我建议大家在初期先记录默认表现,然后逐步尝试优化策略。比如我曾经尝试关闭一些后台调度任务,结果发现整体响应更快,但偶尔会缺少一些提醒,这就需要权衡利弊。

界面与用户体验优化

虽然OpenClaw的界面本身不复杂,但我个人觉得细节决定体验。比如调整主题颜色、优化字体大小或者整理功能面板,都能让日常使用更加舒适。我曾经在夜晚长时间使用时,调暗界面亮度明显减少了视觉疲劳。

值得注意的是,用户体验优化不仅仅是美观,还包括操作流畅度。例如,我会根据自己的习惯,把常用功能放在容易点击的位置,这样在处理大量消息或调用模型时,可以省下不少操作时间。这个过程让我体会到,软件的易用性和效率其实是紧密相连的。

安全性与稳定性提升

有些人可能觉得免费版不需要太关注安全,其实我个人不这么认为。运行在本地的软件,如果不注意权限管理和安全配置,很容易留下隐患。我通常会做几件事:限制运行账户权限、启用防火墙规则、定期检查日志异常。这样虽然增加了一些维护成本,但从长远来看,值得。

此外,我还会定期运行健康检查脚本,确保各个模块正常运行。这样即便出现小问题,也能及时发现并修复。我发现,这种习惯能大大降低意外宕机的概率,让整个使用体验更稳定可靠。

OpenClaw免费版常见问题解答

安装与启动问题

遇到安装失败或启动报错的情况其实并不少见。我自己最初也碰到过,常见原因大致可以归结为三类:环境不符合要求、权限不足、依赖下载失败。解决办法往往是先确认Node.js版本是否正确,WSL2是否启用,以及网络是否畅通。真的有时候,只是一个小小的权限问题,重新赋予执行权限就能解决。

我记得有一次,脚本运行到一半突然中断,我花了半天才发现是防火墙拦截了下载。这个经历让我意识到,安装环境检查的重要性往往被忽视,但它决定了整个部署是否顺利。

功能与兼容性问题

功能不兼容或模型调用异常,也可能让人抓狂。我自己遇到过不同消息平台集成时出现兼容问题,最开始甚至以为是软件缺陷。后来才发现,只是配置不当或者依赖版本不匹配。经验告诉我,仔细核对配置和依赖,比盲目尝试要高效得多。

另外,OpenClaw支持接入多种消息平台和模型,但每个平台可能有细微差别。我的做法是逐一验证,每次修改配置后都跑一次健康检查,这样可以及时发现潜在问题。虽然有点繁琐,但长远来看,这种谨慎能避免大量麻烦。

总结来看,OpenClaw免费版的安装和优化并不是单一步骤,而是一个系统的、渐进的过程。从环境准备、脚本安装,到性能调整、界面优化,再到安全管理,每一步都值得细心对待。我个人体会是:耐心和观察力是使用OpenClaw的关键,这不仅能提高效率,还能让整个工具真正发挥价值。希望这篇经验分享,能让你少走弯路,更快享受到OpenClaw带来的便利。

OpenClaw免费版安装前需要准备哪些环境?

需要安装Node.js 22及以上版本,并在Windows系统下启用WSL2。同时确保系统权限充足和网络稳定,以保证安装顺利。

安装脚本和手动安装有什么区别?

官方提供的一键部署脚本覆盖大部分操作系统和常见场景,可以自动下载依赖和配置环境变量,减少手动配置出错的风险。

如何优化OpenClaw的性能和界面体验?

可以通过调整配置参数、管理运行权限和优化网络环境来提升性能,同时根据个人习惯调整界面布局和功能调用顺序,以获得更流畅的操作体验。

遇到安装报错该如何排查?

首先检查Node.js版本和WSL2环境是否正确启用,其次确认系统权限和网络状态,再对照安装脚本提示逐步排查错误。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://www.siyushenqi.com/72919.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫