OpenClaw+Gemini 3 Pro 简介

OpenClaw 概述

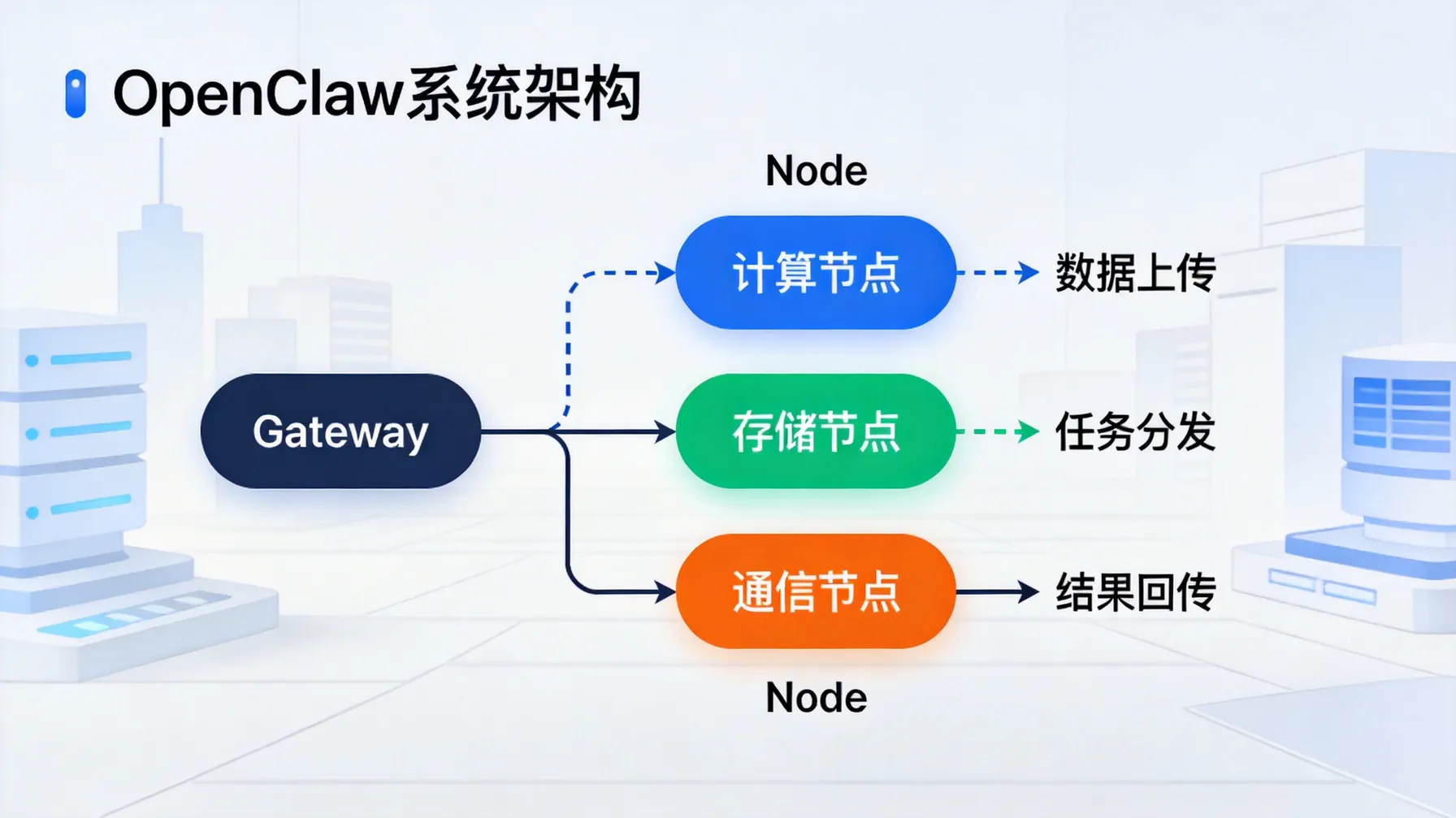

OpenClaw 是一种高效的硬件加速技术,旨在为计算密集型应用提供出色的处理能力。通过集成在服务器中,OpenClaw 能够加速数据的传输与处理,特别是在需要高并发处理的 API 请求中。它的设计使得开发人员可以更专注于应用层的逻辑优化,而无需过多担心底层的性能瓶颈。

与传统的 CPU 处理方式不同,OpenClaw 提供了一种针对特定任务进行硬件优化的解决方案。通过减少数据传输的延迟和提升计算速度,OpenClaw 为 API 加速奠定了基础。

Gemini 3 Pro 特性

Gemini 3 Pro 是一款强大的人工智能加速卡,专为高性能计算和机器学习任务设计。其最显著的特点是具有卓越的处理能力和高度的并行计算能力,这使得它在 API 加速领域有着广泛的应用前景。它结合了先进的硬件架构和高效的算法,能够显著提高 API 请求处理的速度,特别是在复杂数据处理和机器学习任务中。

此外,Gemini 3 Pro 在兼容性和集成性方面也有很大优势。无论是与传统的硬件平台还是与 OpenClaw 集成,它都能无缝连接,从而进一步提高系统的整体性能。

私有环境中的 API 加速需求

私有环境与公共环境的区别

在公共环境中,API 通常依赖于共享的资源池,这使得其性能在高并发情况下容易受到影响。而私有环境则提供了更高的控制性和专用资源,这对于需要高度安全性和稳定性的企业尤为重要。私有环境下的 API 加速,意味着每个请求都可以优先利用本地资源,避免因外部流量波动而影响性能。

然而,这也带来了额外的挑战,尤其是如何在不牺牲安全性和隐私的前提下,实现高效的加速。私有环境中的 API 加速需要通过专门的硬件和优化算法来实现,这就要求技术方案必须具备更高的定制化和灵活性。

API 加速的挑战与机遇

API 加速的主要挑战之一是如何有效地利用现有的硬件资源,避免资源浪费。对于私有环境来说,硬件的优化配置往往需要更细致的调整,以确保其能够满足特定应用场景的需求。此外,API 加速还涉及到网络延迟、请求并发等因素,这些都需要从多方面进行考虑。

但与此同时,这也是一个巨大的机遇。通过精确的硬件加速和软件优化,私有环境下的 API 请求处理可以大大提升效率,减少响应时间,从而为企业带来更好的用户体验和更高的业务价值。

OpenClaw+Gemini 3 Pro 的 API 加速原理

硬件加速与软件优化

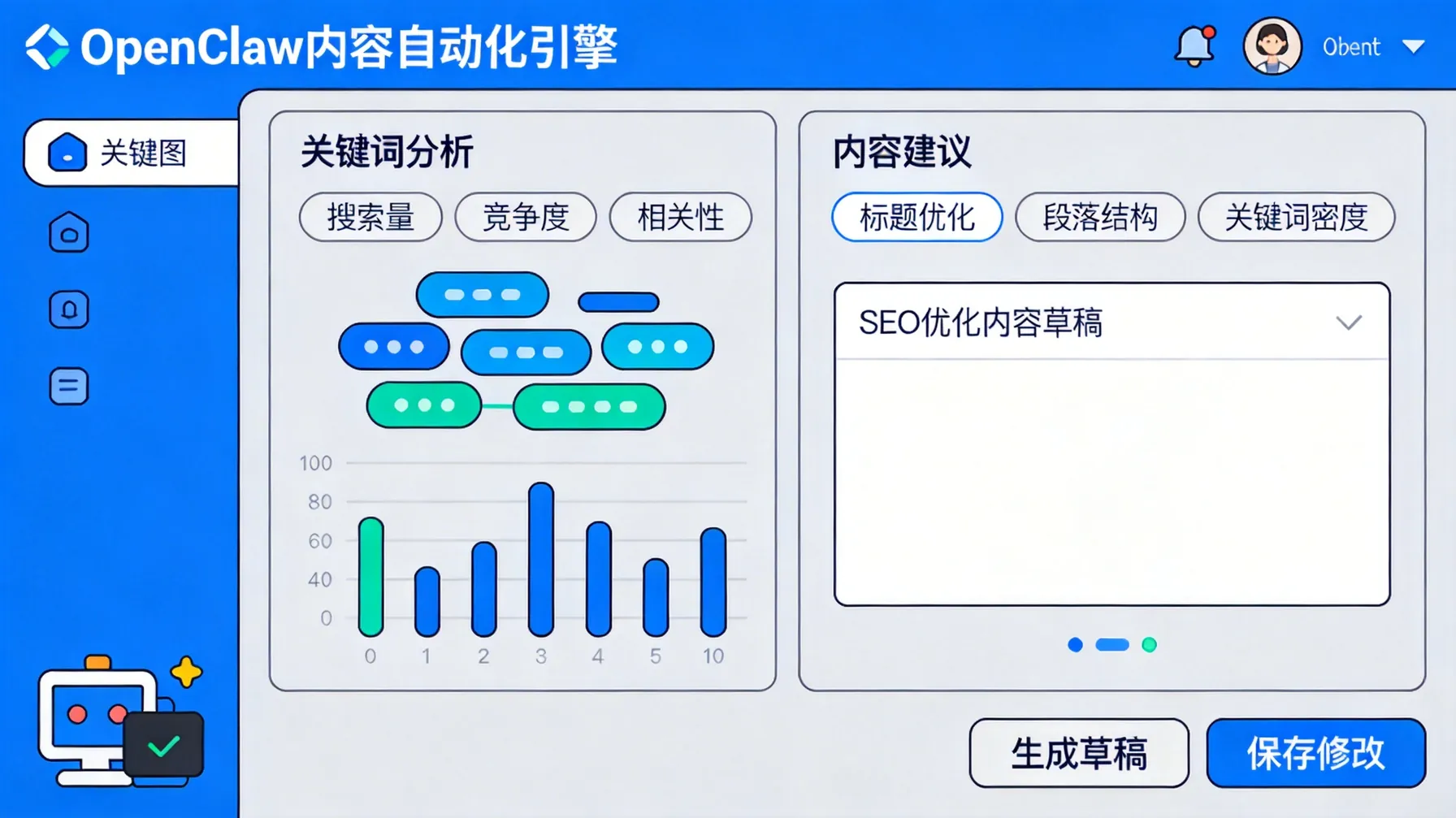

硬件加速和软件优化是 OpenClaw 和 Gemini 3 Pro 联手提升 API 加速的两大核心原理。OpenClaw 的硬件加速能够通过减少计算瓶颈、提升数据处理速度,为 API 请求提供高效的底层支持。而 Gemini 3 Pro 则通过其强大的并行计算能力,优化算法的执行效率,使得 API 请求能够在更短时间内得到处理。

在软件优化方面,合理的负载均衡、智能调度以及缓存策略的应用,都能进一步提升加速效果。通过高效的软件调度,能够最大限度地发挥硬件加速的优势,使得 API 请求的响应速度得到显著提升。

API 请求处理流程优化

API 请求的处理流程是影响性能的关键因素之一。OpenClaw 和 Gemini 3 Pro 的协作,使得数据的传输与计算能够在多个层次上进行优化。例如,OpenClaw 可以通过硬件级别的加速来减少请求数据传输的延迟,而 Gemini 3 Pro 则通过智能算法和并行计算来提高数据处理的效率。

通过这种多层次的优化,API 请求的处理流程不仅在硬件层面得到了加速,同时在软件层面也得到了智能调度和优化,从而极大提升了整体的响应速度。

集成技巧与最佳实践

如何高效集成 OpenClaw+Gemini 3 Pro

高效集成 OpenClaw 和 Gemini 3 Pro 需要从系统架构设计、硬件选择、软件优化等多个角度进行考虑。首先,系统架构设计应当支持硬件加速与软件优化的协同工作,确保数据流能够无缝传递,并在合适的时机交给硬件处理。

其次,硬件选择必须依据实际需求进行定制。不同类型的 API 请求有着不同的处理需求,因此需要根据具体情况选择适合的硬件配置。最后,软件层面应当注重算法优化和数据调度,充分利用硬件加速的潜力。

API 加速集成中的常见问题及解决方案

在集成 OpenClaw 和 Gemini 3 Pro 时,常见的问题之一是硬件兼容性问题。不同的硬件平台可能会存在兼容性差异,因此在集成前需要进行充分的测试,确保硬件之间的协同工作不会受到影响。

另外,API 请求的负载均衡也是一个常见的挑战。如果负载分配不均,某些请求可能会由于资源过度集中而导致响应延迟。对此,合理的负载均衡策略和动态调度机制能够有效地解决这个问题。

性能评估与监控

性能监控工具与方法

性能评估和监控是确保 API 加速效果的重要手段。常用的性能监控工具包括 Prometheus、Grafana 等,这些工具能够实时监测 API 请求的响应时间、系统负载、资源使用情况等关键指标。通过对这些数据的监控,开发人员可以及时发现性能瓶颈并进行优化。

此外,AI 驱动的智能监控工具也在逐步成为主流,它们能够基于历史数据进行预测分析,提前发现潜在的性能问题。

性能优化建议

为了进一步优化 API 加速效果,可以从多个方面入手。首先,优化数据传输路径,减少不必要的数据传输延迟。其次,通过智能算法和数据预处理来减少每次请求的计算量。此外,还可以通过细化负载均衡策略,使得每个请求都能在最合适的硬件资源上处理。

当然,这些优化措施的实施需要根据具体的应用场景来定制。每个企业的需求都不同,因此在进行性能优化时,必须深入了解系统的工作负载和实际使用情况。

总结与展望

OpenClaw 和 Gemini 3 Pro 如何提升 API 响应速度?

OpenClaw 提供硬件级加速,减少数据传输延迟,而 Gemini 3 Pro 利用并行计算能力优化复杂任务处理,两者结合可显著提升 API 请求的处理速度。

在私有环境中部署 API 加速有哪些挑战?

私有环境通常资源有限且隔离,面临硬件兼容性、网络带宽限制以及系统稳定性等挑战,需要针对性优化加速方案和集成策略。

Gemini 3 Pro 是否兼容不同硬件平台?

是的,Gemini 3 Pro 设计具备良好的兼容性,可以与传统硬件平台及 OpenClaw 无缝集成,从而提升整体性能。

如何在私有环境中优化 API 集成效果?

可以通过硬件加速卡与计算优化策略结合,调整 API 调用流程和数据处理逻辑,充分利用 OpenClaw 与 Gemini 3 Pro 的性能优势,提高响应效率。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://www.siyushenqi.com/72942.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫