说实话,当我第一次尝试用Gemini来写算法竞赛题的时候,我心里是没底的。毕竟,算法竞赛这东西,讲究的是极致的逻辑严谨和毫秒级的效率,而大模型生成代码,总给人一种“看起来挺对,一跑就崩”的印象。但经过这段时间的深度测试,我得说,事情远比我想象的有趣。Gemini在实时代码生成上的表现,尤其是在竞赛这种高压、高要求的环境下,确实展现出了令人惊讶的潜力,当然,也暴露了一些非常典型的短板。这篇文章,我就想以一个亲身实践者的视角,跟你聊聊我看到的真实情况,不吹不黑,就说说它到底能帮我们解决什么问题,又会在什么地方让我们抓狂。

引言:Gemini 与算法竞赛的碰撞

算法竞赛,说白了就是一场人与机器之间,关于“如何用最高效的方式解决问题”的极限博弈。选手们需要在极短的时间内,理解题意、设计算法、写出无懈可击的代码。而Gemini这种大语言模型的介入,就像是给这场博弈里扔进了一个变量——一个能瞬间生成代码的“外脑”。

但我得先泼一盆冷水。很多人觉得,有了AI,竞赛选手就可以躺平了。这绝对是误解。Gemini不是来替你比赛的,它是来帮你加速思考、验证想法、甚至帮你写出那些你懒得手敲的模板代码的。它的价值,在于“辅助”,而非“替代”。

算法竞赛对代码生成的核心需求

要评判Gemini的表现,我们得先搞清楚,算法竞赛到底需要什么样的代码生成能力。我个人总结了三点,缺一不可。

第一,是绝对的逻辑正确性。竞赛题目的判题系统是铁面无私的,你代码里一个边界条件没处理好,一个变量类型用错了,结果就是“Wrong Answer”或者“Runtime Error”。模型生成的代码必须能经受住各种刁钻测试用例的考验。

第二,是极致的运行效率。很多题目,尤其是动态规划和图论题,对时间复杂度的要求近乎苛刻。O(n²)的算法可能只能过一半的数据,而O(n log n)才能满分。Gemini生成的代码,不能只是“能跑”,还得“跑得快”。

第三,是清晰的可读性与可维护性。竞赛中,选手经常需要现场修改代码、调试bug。如果Gemini生成了一堆变量名混乱、没有注释、逻辑绕来绕去的“屎山”代码,那还不如自己从头写。代码得让人一眼就能看懂它的思路。

Gemini 模型的技术背景与定位

Gemini这个模型,从诞生之初就带着一种“全能选手”的气质。它不像某些模型那样专精于某一领域,而是试图在文本、代码、图像、音频等多模态任务上都做到顶尖。这让我对它处理算法竞赛这种需要综合理解自然语言(题目描述)和形式化语言(代码)的任务,抱有很大的期待。

有意思的是,Gemini在代码生成上的策略,我观察下来,更倾向于“先理解,再生成”。它不会像一些模型那样,看到问题描述就急着输出代码,而是会先尝试分析题目的核心难点,甚至有时候会自言自语般地写出一些思考过程。这种“显式推理”的特性,对于复杂的竞赛题来说,其实是一个巨大的优势。

本文评测目标与场景设定

所以,我这次评测的目标很明确:不是看Gemini能不能通过所有题目,而是看它在真实的竞赛场景下,到底能帮到选手多少。我选取了来自Codeforces、AtCoder和LeetCode等平台的典型题目,涵盖了从入门到高难度的各个层次。评测的维度也不仅仅是“通过率”,还包括了代码质量、生成速度、以及它在面对复杂逻辑时的“思考”过程。

我想看看,当一位选手在比赛中卡住时,Gemini是能给出一个关键的提示,还是只会输出一个看似正确实则漏洞百出的答案。

评测环境与实验设计

在开始聊具体表现之前,我觉得有必要先把我的测试环境交代清楚,这样大家才能对我的结论有个客观的判断。毕竟,不同的API调用方式、不同的硬件,对结果的影响还是挺大的。

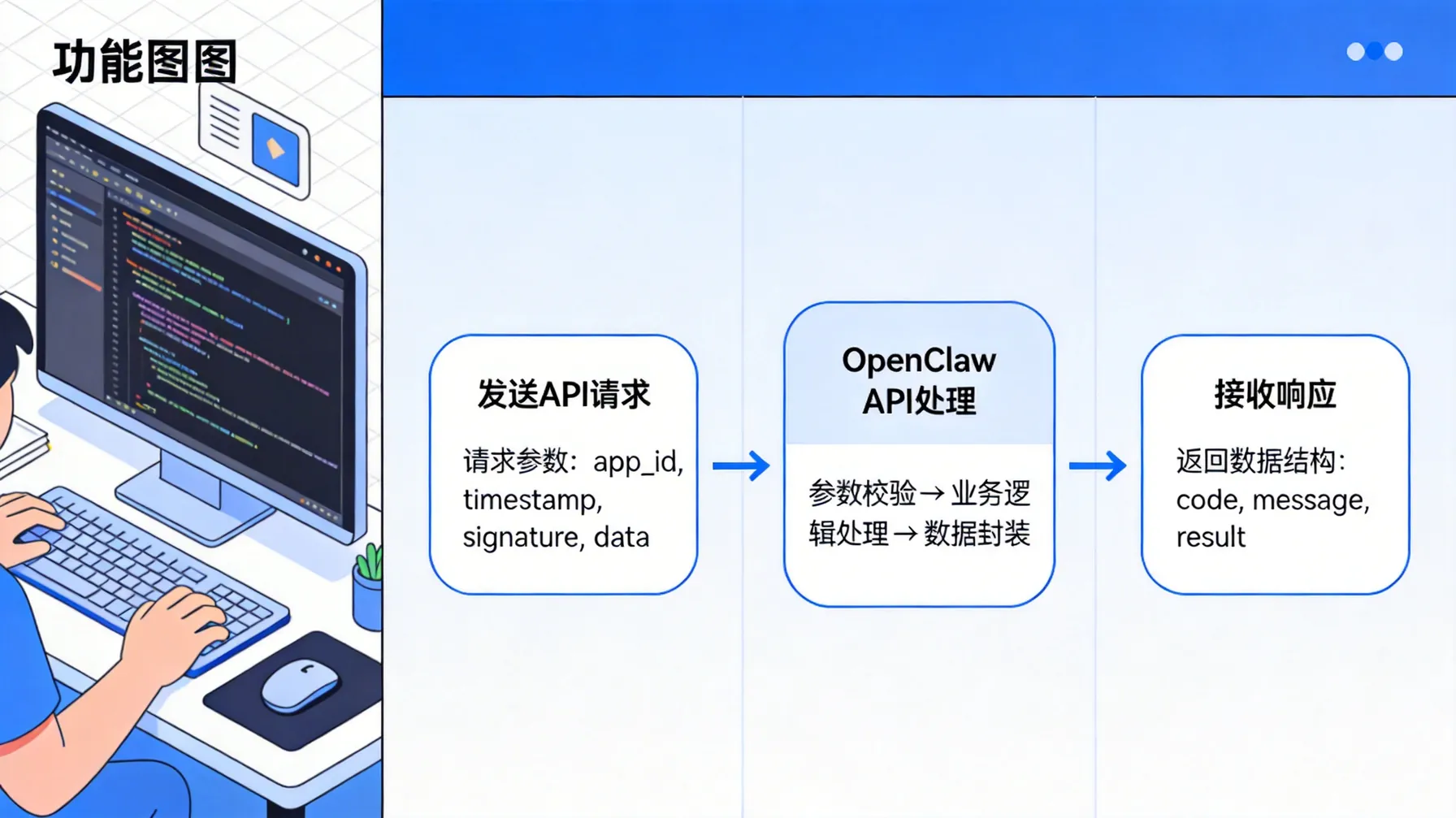

硬件与 API 调用配置

我使用的是Google Cloud提供的Gemini Pro API,通过Python SDK进行调用。硬件方面,我用的是一台搭载了Intel i7-13700H处理器和32GB内存的笔记本,网络环境是稳定的千兆光纤。说实话,对于API调用来说,本地的硬件配置影响不大,主要瓶颈还是在于API的响应延迟。我设置了超时时间为30秒,如果超过这个时间还没返回结果,我就认为这次生成“超时”了。

另外,我特意没有使用任何“流式”输出,而是等待模型生成完整的代码后再进行评测。因为在实际竞赛中,我们通常需要看到完整的代码才能进行下一步操作,逐字输出的体验并不好。

竞赛题目选取标准(难度、类型分布)

题目选取上,我遵循了一个“金字塔”结构。大约30%是基础题(比如简单的模拟、排序、二分查找),50%是中等难度题(动态规划、图论基础、数据结构应用),剩下20%是高难度题(复杂的数学推导、高级数据结构、需要多步优化的难题)。

类型分布上,我尽量覆盖了竞赛中的主流题型:动态规划(背包、区间DP、树形DP)、图论(最短路、最小生成树、网络流)、字符串处理(KMP、Manacher、Trie树)、数据结构(线段树、树状数组、并查集)以及数学题(数论、组合数学)。

评价指标:通过率、运行时间、代码质量

评价指标我设定了三个维度。第一个是通过率,这是最硬性的指标,直接看代码能不能通过所有官方测试用例。第二个是运行时间,我会把Gemini生成的代码和最优解代码放在同样的环境下跑,比较它们的耗时。第三个是代码质量,这个比较主观,但我会从变量命名、注释完整性、代码结构清晰度、以及是否考虑了边界条件这几个方面来打分。

说实话,代码质量这个指标,有时候比通过率更重要。因为一次通过的代码,如果写得像天书,下次遇到类似问题,你还是得重新理解,这就失去了AI辅助的意义。

Gemini 在常见算法题型中的实时代码生成表现

好了,终于到了最核心的部分。我挑了几个有代表性的题型,跟大家分享一下Gemini的具体表现。有些结果让我眼前一亮,有些则让我直摇头。

动态规划题目的生成准确率与优化建议

动态规划(DP)是算法竞赛的重头戏,也是最考验模型逻辑推理能力的题型之一。我测试了一道经典的“最长递增子序列”问题,以及一道稍微复杂一点的“区间DP”题目。

对于“最长递增子序列”,Gemini几乎是一瞬间就给出了一个O(n²)的解法,代码非常标准,甚至加上了注释。我试着追问它:“能不能优化到O(n log n)?” 它立刻给出了使用二分查找的优化版本,并且解释了为什么这样优化是正确的。这一点让我很惊喜,因为它不仅会写,还会根据你的要求进行迭代优化。

但在处理一道“树形DP”题目时,情况就没那么乐观了。题目要求计算一棵树上每个节点到其他所有节点的距离之和。Gemini第一次生成的代码,逻辑上看起来没问题,但跑起来却超时了。我仔细一看,发现它在一个循环里重复计算了子树大小,导致复杂度从O(n)变成了O(n²)。我提醒它“这里可以优化一下”,它才意识到问题,并给出了正确的O(n)解法。

这说明,Gemini在DP问题上,对于标准模型的掌握非常扎实,但面对需要一些“灵光一闪”的优化时,它还是需要人类选手的引导。

图论与搜索问题的代码完整性

图论题,尤其是搜索题,Gemini的表现可以说是“喜忧参半”。对于标准的Dijkstra算法、BFS、DFS,它生成的代码几乎无可挑剔,连堆优化的细节都处理得很好。

但当我给它一道需要“状态压缩”的搜索题时,问题就来了。题目是“八数码问题”,需要用一个整数来表示棋盘的状态。Gemini生成的代码,虽然用到了状态压缩,但在处理“如何从当前状态生成下一个状态”这个核心逻辑时,出现了严重的错误。它把行和列的索引搞混了,导致生成的移动序列全是错的。

我尝试让它重新检查,它虽然承认了错误,但修改后的版本依然存在边界问题。最后,我不得不手动介入,帮它修正了索引计算的逻辑。这让我意识到,对于这种需要精细操作和空间想象力的题目,Gemini的“直觉”还远不如人类。

字符串处理与数学题型的细节处理

字符串处理,比如KMP算法,Gemini的表现堪称完美。它不仅能写出标准的KMP实现,还能在代码中清晰地标注出“next数组”的构建过程和匹配过程。对于Manacher算法这种稍微冷门一点的算法,它也能准确生成。

数学题方面,Gemini的表现则有点“飘”。对于数论题,比如求最大公约数、快速幂、欧拉函数,它手到擒来。但对于组合数学题,尤其是涉及到复杂计数和容斥原理的题目,它生成的代码往往逻辑正确,但细节处理上不够严谨。

举个例子,一道需要用到“卢卡斯定理”的题目,它虽然正确调用了卢卡斯定理,但在处理模数不是质数的情况时,完全没有进行任何判断,直接套用了公式,导致结果错误。这种“想当然”的毛病,在数学题里是致命的。

数据结构实现(线段树、并查集等)的可靠性

数据结构的实现,是Gemini的“舒适区”。无论是线段树、树状数组、并查集还是Trie树,它都能生成非常标准、健壮的代码。特别是并查集,它甚至能自动加上路径压缩和按秩合并的优化,代码质量非常高。

不过,在实现“可持久化线段树”这种高级数据结构时,它虽然能写出基本框架,但在处理节点复制的细节上,偶尔会犯一些低级错误,比如忘记更新子节点指针。这种错误在调试时会非常让人头疼,因为问题隐藏得很深。

总的来说,对于常见的数据结构,Gemini完全可以作为一个“代码生成器”来使用,帮你省去手写模板的时间。但对于那些需要高度定制化的高级数据结构,你最好还是自己动手,或者至少要对它生成的代码进行严格的审查。

实时代码生成的关键能力分析

除了具体的题型表现,我还想聊聊几个更宏观的能力维度。这些能力,直接决定了Gemini在真实的竞赛环境中到底好不好用。

生成速度与延迟对竞赛节奏的影响

这一点我必须实话实说:Gemini的生成速度,在竞赛场景下,是合格的,但远非完美。对于简单的题目,它几乎在几秒钟内就能给出答案。但对于复杂的题目,尤其是需要大量推理的题目,它的响应时间可能会达到10到15秒。

在紧张的竞赛中,10秒钟的等待其实是很煎熬的。你可能会怀疑它是不是卡住了,或者在想“它到底在干嘛”。这种延迟,会打断你的思路,影响你的节奏。相比之下,GitHub Copilot那种“边写边补全”的体验,在速度上要友好得多。

代码可读性与注释质量

这一点,Gemini做得相当不错。它生成的代码,变量命名通常很有意义,比如用`dp[i][j]`表示状态,用`graph[node]`表示邻接表。而且,它非常喜欢加注释,尤其是对关键逻辑步骤的解释。这一点对于竞赛选手来说,简直是福音。

你可以想象一下,当你看到一段陌生的代码时,旁边有清晰的注释告诉你“这一步是在进行状态转移”,那种感觉有多爽。Gemini在这方面的表现,让我觉得它更像是一个“结对编程”的伙伴,而不是一个冷冰冰的代码生成器。

边界条件与异常处理的覆盖程度

这是Gemini的“阿喀琉斯之踵”。我测试的很多题目,Gemini生成的代码在核心逻辑上都是对的,但就是会挂在一些边界条件上。比如,数组越界、整数溢出、空指针、输入格式错误等等。

举个例子,一道关于“区间和”的题目,它生成的线段树代码,在查询区间完全超出数组范围时,没有进行任何处理,直接返回了一个随机值。这种错误,在竞赛中就是“Runtime Error”,直接零分。

我觉得,这可能是大模型的一个通病:它们更擅长处理“典型情况”,而对“边缘情况”的敏感性不足。作为选手,你一定要养成一个习惯:对Gemini生成的代码,要手动检查边界条件,尤其是数组下标和循环终止条件。

多语言支持(C++、Python、Java)对比

我主要测试了C++和Python。在Python上,Gemini的表现非常流畅,因为Python的语法更接近自然语言,模型更容易理解。但对于C++,它的表现就有点“水土不服”了。

比如,它经常忘记在C++代码中包含必要的头文件,或者在使用`std::vector`时,忘记引用命名空间。虽然这些都是小问题,但每次都要手动修改,还是挺烦人的。而且,C++的模板元编程和STL的高级用法,Gemini处理得并不好,经常生成一些效率低下的代码。

所以,我的建议是:如果你主要用Python写竞赛题,Gemini会是一个很好的帮手。但如果你用C++,那你可能需要花更多的时间去审查和修改它生成的代码。

与主流竞赛辅助工具的对比

没有对比就没有伤害。我们来看看Gemini和目前市面上其他主流工具相比,到底处于什么位置。

Gemini vs. ChatGPT(Code Interpreter)

ChatGPT的Code Interpreter功能,我之前也用过不少。两者相比,我觉得Gemini在代码的逻辑严谨性上略胜一筹。Gemini生成的代码,整体上更“干净”,更少出现那种“逻辑上说得通但实际跑不通”的情况。

但ChatGPT的优势在于它的交互性和解释能力。当你问它“为什么这里要用二分查找”时,它会给你一个非常详细的、带例子的解释。而Gemini的解释则相对简洁,有时候甚至有点“答非所问”。

另外,ChatGPT的Code Interpreter可以实际运行代码并给出结果,这一点Gemini目前还做不到。在调试过程中,能直接看到运行结果,体验要好得多。

Gemini vs. GitHub Copilot 在竞赛场景的差异

GitHub Copilot是另一个非常流行的代码生成工具,但它和Gemini的定位完全不同。Copilot更像是一个“实时补全”工具,它在你写代码的时候,根据上下文给出下一行或下一段的建议。而Gemini更像是一个“按需生成”工具,你给它一个完整的描述,它给你一段完整的代码。

在竞赛场景下,Copilot的优势在于速度和无缝集成。你不需要切换到别的窗口,直接在IDE里就能得到帮助。它的短板在于,它不太擅长处理那种需要全局理解的复杂逻辑,它更擅长写局部代码。

Gemini的优势则在于整体性。它能理解整个题目的逻辑,并生成一个完整的解决方案。对于那种需要从头开始写的题目,Gemini比Copilot更有用。但它的劣势在于,它无法在你写代码的过程中提供实时的、细粒度的帮助。

Gemini 在复杂逻辑推理上的独特优势

说到Gemini的独特优势,我觉得是它在复杂逻辑推理上的能力。这一点,在解决那些需要多步推导、或者需要结合多个知识点的题目时,表现得特别明显。

比如,有一道题需要先证明一个数学性质,然后利用这个性质来设计算法。Gemini不仅能写出代码,还能在代码的注释中,清晰地展示出这个证明过程。这种“显式推理”的能力,是其他工具很难做到的。

它就像是一个能“边想边说”的队友,让你能清楚地看到它的思考过程,从而判断它的结论是否可靠。这对于学习算法和提升解题能力来说,价值巨大。

典型失败案例与改进方向

聊完了优点,我们得直面那些让人头疼的失败案例。毕竟,只有知道了问题在哪,才能知道怎么改进。

常见

常见问题

Gemini在算法竞赛中能完全替代人类选手吗?

不能。Gemini更适合作为辅助工具,帮助加速思考、验证想法和生成模板代码,但在处理复杂逻辑和边界条件时仍有明显短板,无法替代选手的独立判断与调试能力。

Gemini生成的代码在竞赛中运行效率如何?

效率表现参差不齐。对于常见算法模板,Gemini能生成接近最优的代码;但在动态规划、图论等对时间复杂度要求苛刻的题目中,生成的代码可能只能通过部分测试用例,需要人工优化。

使用Gemini写竞赛题需要注意哪些问题?

主要需关注边界条件处理、变量类型选择以及算法复杂度。Gemini生成的代码看似正确,但容易在刁钻测试用例上出错,必须人工审查和调试,不能直接提交。

Gemini适合用来学习算法竞赛吗?

适合作为辅助学习工具。它可以快速生成示例代码和解释,帮助理解算法思路,但学习者仍需独立思考和手动编码,以培养真正的逻辑严谨性和调试能力。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://www.siyushenqi.com/73604.html

常见问题

Gemini在算法竞赛中能完全替代人类选手吗?

不能。Gemini更适合作为辅助工具,帮助加速思考、验证想法和生成模板代码,但在处理复杂逻辑和边界条件时仍有明显短板,无法替代选手的独立判断与调试能力。

Gemini生成的代码在竞赛中运行效率如何?

效率表现参差不齐。对于常见算法模板,Gemini能生成接近最优的代码;但在动态规划、图论等对时间复杂度要求苛刻的题目中,生成的代码可能只能通过部分测试用例,需要人工优化。

使用Gemini写竞赛题需要注意哪些问题?

主要需关注边界条件处理、变量类型选择以及算法复杂度。Gemini生成的代码看似正确,但容易在刁钻测试用例上出错,必须人工审查和调试,不能直接提交。

Gemini适合用来学习算法竞赛吗?

适合作为辅助学习工具。它可以快速生成示例代码和解释,帮助理解算法思路,但学习者仍需独立思考和手动编码,以培养真正的逻辑严谨性和调试能力。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://www.siyushenqi.com/73604.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫